2025년 4월 1주차 데이터 시각화 큐레이션

여러분은 AI 검색 엔진을 자주 사용하시나요? 챗GPT와 제미나이 같은 AI 검색 엔진은 인터넷에 있는 방대한 정보를 참고해서 새롭게 각색해서 답변하는데요. 이러한 답변을 신뢰하려면 정보의 출처를 함께 확인해야 한다고 합니다. 그렇다면 과연 AI 검색 엔진들은 정보의 출처를 정확히 제공하고 있을까요? 이를 확인하기 위해 컬럼비아 저널리즘 스쿨 산하의 The Tow Center for Digital Journalism은 총 8개의 AI 검색 엔진을 대상으로 뉴스 원문을 제공하며 출처를 밝히도록 요구했고, 이들의 답변을 모두 기록했다고 합니다. 결과는 어땠을까요? 오늘은 AI 검색 엔진의 정보를 바탕으로 제공된 출처의 정확성을 시각화로 확인해 보겠습니다.

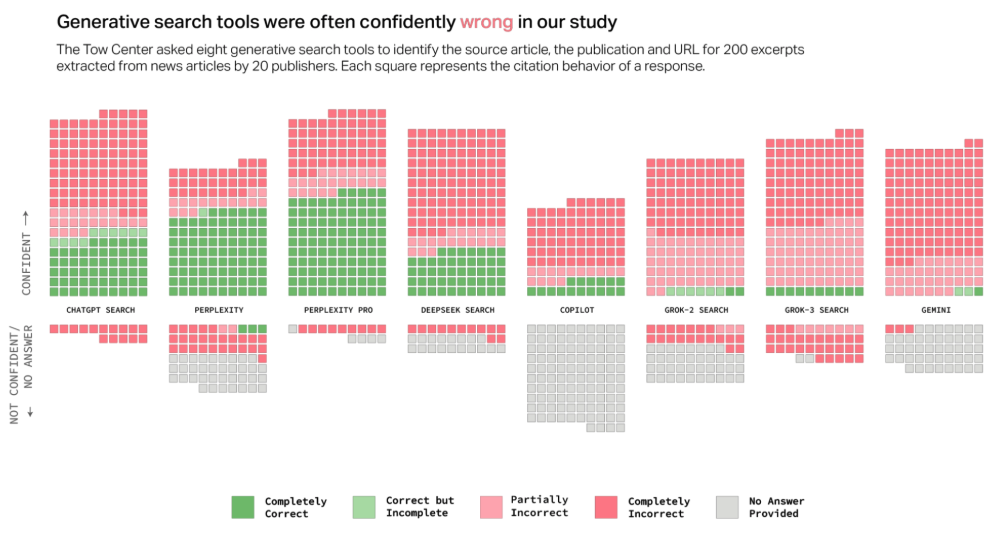

오늘 소개할 시각화는 검색 엔진의 답변 횟수와 표기된 출처의 정확성을 나타낸 와플 차트 (waffle chart)입니다. 와플 차트의 각 블록은 개별 답변 의미하며, 차트의 가로 중앙을 기준으로 상단은 당당한 태도의 답변, 하단은 불확실 태도의 답변 혹은 무응답으로 구분됩니다. 차트의 색상을 통해 정확도를 판단할 수 있는데요! 짙은 초록색과 옅은 초록색은 각각 정확한 답변과 정확하지만 불완전한 답변을 의미하는 반면, 옅은 빨간색과 짙은 빨간색은 각각 부분적으로 틀린 답변과 완전히 틀린 답변을 의미합니다. 회색은 무응답을 뜻합니다.

차트를 보면, 전체적으로 틀린 답변을 나타내는 빨간색이 정확한 답변을 뜻하는 초록색보다 압도적으로 많다는 것을 확인할 수 있는데요! 8개의 검색 엔진 중 특히 틀린 답변을 많이 제공한 것은 차트 맨 오른쪽 마지막 두 번째에 위치한 Grok-3 Search입니다. 반면, 상대적으로 정확한 답변을 자주 제공한 것은 차트 맨 왼쪽에서부터 세 번째에 위치한 Perplexity Pro로 나타났습니다. 앞서 언급한 것처럼, 차트의 가로 중앙을 기준으로, AI 검색 엔진의 답변 태도가 나뉜다고 했는데요. 8개 검색 엔진 모두 대부분의 블록이 상단에 있어, 틀린 답변 또한 당당하게 제시하고, 사용자들이 이를 신뢰함으로써 거짓 정보를 판별하지 못하는 상황이 초래할 수 있다는 것을 시사합니다.

오늘의 사례로 AI 검색 엔진의 답변을 모두 신뢰하기 어렵다는 사실을 다시 한 번 깨달을 수 있었는데요. 앞으로 AI 검색 엔진을 활용할 때, 제공된 출처 또한 유의하며 정보를 수용해야 할 것 같네요! 해당 콘텐츠는 일반 버전과 프리미엄 구독 버전의 AI 검색 엔진의 답변을 비교하기도 했는데요! 궁금하신 분들은, 출처 링크에 접속해 보시길 추천 드립니다!